AMD MI350X : quand David défie Goliath sur le marché de l'IA

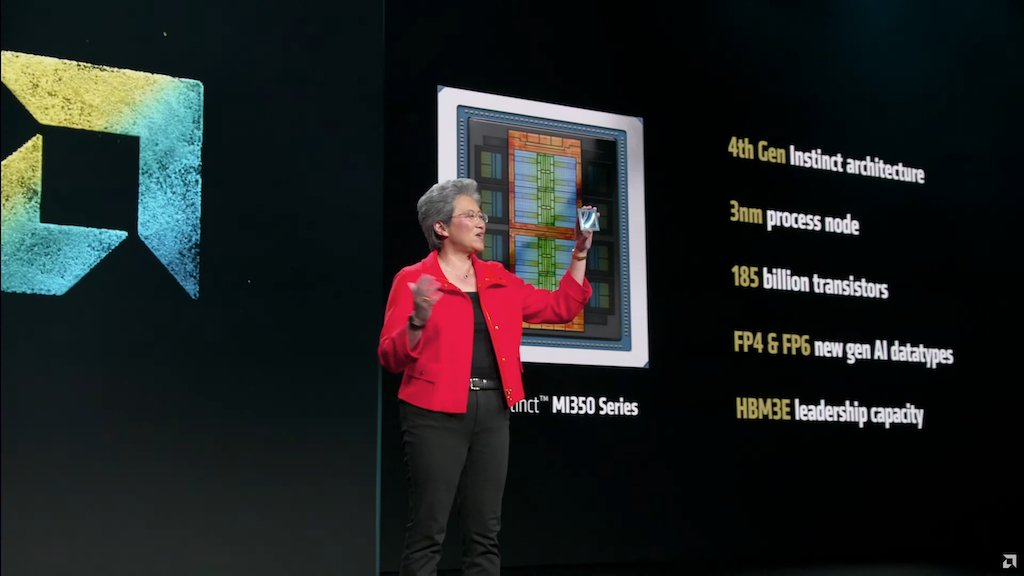

AMD bouscule le marché de l'IA avec sa série MI350X gravée en 3nm : performances quadruplées, précision 6 bits inédite et architecture modulaire défient directement la domination de Nvidia.

Le marché des accélérateurs IA connaît un bouleversement majeur. AMD vient de dévoiler sa série MI350X lors de l'événement "Advancing AI" à San José, propulsant la firme au cœur de la bataille technologique contre le géant Nvidia. Cette nouvelle génération de processeurs graphiques pourrait redistribuer les cartes dans un secteur dominé à 92% par un seul acteur.

De l'outsider au challenger crédible

Le MI350X s'inscrit dans une stratégie progressive de rattrapage d'AMD, succédant au MI325X lancé fin 2024. L'évolution est radicale avec l'adoption de l'architecture CDNA 4 gravée en 3 nm, marquant l'abandon de l'approche monolithique traditionnelle au profit d'une conception modulaire en chiplets, déjà éprouvée sur les processeurs EPYC. Cette approche permet d'optimiser chaque composant selon sa fonction : unités de calcul en 3 nm pour les performances, circuits d'entrées-sorties en 6 nm pour la connectivité.

Les performances annoncées impressionnent : quadruplement des capacités par rapport à la génération précédente. Ce bond générationnel traduit la détermination d'AMD à combler rapidement son retard technologique.

Une architecture qui change la donne

Le MI350X innove avec une organisation interne repensée autour de 32 cœurs CDNA 4 répartis en huit circuits XCD (Extreme Compute Dies) de quatre cœurs chacun. Cette structure offre un avantage opérationnel décisif : chaque circuit XCD fonctionne de manière autonome, permettant l'exécution simultanée de huit modèles d'IA de 70 milliards de paramètres sans interférence.

La mémoire constitue un atout majeur avec 288 Go de HBM3e offrant une bande passante de 8 To/s. Ce volume dépasse de 60% celui du Nvidia B200 et permet théoriquement de traiter des modèles linguistiques atteignant 520 milliards de paramètres.

L'innovation technique la plus significative réside dans la prise en charge native de la précision 6 bits. Ce format hybride combine l'efficacité du 4 bits à la qualité du 8 bits, doublant les performances par rapport au B200 de Nvidia. Les chiffres avancés par AMD sont éloquents : 18,4 Pétaflops/s en précision 4 et 6 bits, contre 10 Pétaflops pour la solution concurrente.

Déploiements et écosystème renforcé

AMD propose deux déclinaisons principales : le MI350X refroidi par air (1000W) et le MI355X refroidi par liquide (1400W). Cette dernière version, overclockée, pousse les performances à 10 Pflops en précision 8 bits. Les configurations serveur intègrent jusqu'à huit GPU par système, totalisant 2,25 To de mémoire HBM3e, avec la possibilité d'atteindre 1,28 Exaflops/s dans une baie complète de 128 GPU MI355X.

La compatibilité avec les formats OCP (Open Compute Platform) facilite l'adoption par les hyperscalers et grands centres de données. L'architecture modulaire s'adapte aux infrastructures existantes sans refonte majeure.

Sur le plan logiciel, la plateforme ROCm 7 accompagne ce lancement avec des améliorations spectaculaires : gain de 3,5 fois en inférence par rapport à ROCm 6, avec des performances particulièrement remarquables sur les modèles Llama 3.1 70B (×3,2) et Qwen2-72B (×3,4).

L'intégration du protocole Ultra-Ethernet via les cartes réseau Pollara 400 optimise les communications inter-GPU, offrant un gain de 20% par rapport aux solutions concurrentes. Cette technologie, équivalente au GPUdirect de Nvidia, élimine le goulot d'étranglement du processeur hôte lors des échanges de données.

Stratégie commerciale agressive

AMD positionne le MI350X comme 40% plus rentable que le B200 de Nvidia, sans préciser si cette comparaison porte sur les coûts d'acquisition ou d'exploitation. Cette stratégie tarifaire s'inscrit dans la tradition d'AMD d'offrir des alternatives économiques performantes pour gagner des parts de marché.

Le fabricant mise également sur l'ouverture technologique, avec des standards interopérables contrastant avec l'écosystème propriétaire CUDA de Nvidia. Cette approche pourrait séduire les entreprises souhaitant diversifier leurs fournisseurs d'infrastructure IA et réduire leur dépendance envers un acteur unique.

La feuille de route est déjà établie avec le MI400 prévu pour 2026, promettant 40 Pflops en 4 bits, 432 Go de mémoire HBM4 et des communications inter-GPU à 300 Go/s. La configuration "Helios" de 72 GPU MI400 viserait l'impressionnant seuil de 2,9 Exaflops en 4 bits.

L'équation du succès reste à résoudre

Le MI350X représente l'offensive la plus sérieuse d'AMD pour contester la domination de Nvidia. Les spécifications techniques et les performances théoriques positionnent ce GPU comme une alternative crédible aux solutions dominantes. Toutefois, le véritable défi réside dans l'adoption par l'écosystème logiciel et la capacité à convaincre les développeurs de migrer leurs applications vers la plateforme ROCm.

Comments ()